NLP 캐글 경진대회개발자_SHINBAK/인공지능 김신박2020. 8. 6. 23:11

Table of Contents

728x90

반응형

NLP 캐글 경진대회 분석

언어모델

Transformer (딥러닝에서 다양한 곳에 쓰이고 있다.)

핵심은 1,2 어트랙션

인풋을 어떻게 구성할 것인가 어떻게 텍스트에 맞출 것인가

단순하게 보면 인코더 디코더 구조 (기계번역 시퀀스 투 시퀀스 ) (6개의 블럭으로 구성)

캐글에서는 생성모델 성능 검증 문제 때문에 잘 안나옴 — GAN

scaled dot - product attention

(물어보는 단어인 '쿼리' 어떤 단어 '키' 그 가중치 '벨류 ') 수학적으로 내적 , softmax 쓰기 때문에 편중될 위험때문에 규제화를 필요

self attention

1.셀프 닷 프로덕트 어텐션

학습 - 어떻게 임베딩 될것 인가 Q k v — output

2.멀티 (헤더)어텐션 - CNN 커널에서 다양하게 뽑 는 방법

실전에서 대부분 지도 학습으로 머신러닝을 하는데 (y값 필요),, 근데 비지도로 학습할수 있는 장점이 있다.

레이블 전처리 과정이 필요없음

(word2bec 도)

BoW

미리 셀프 어텐션으로 만들어 놓고 그 다음 넣으면 굉장히 성능이 좋아진다. (프리 프레이닝)

어노테이션 비용때문에 이런 전처리가 없는게 코스트가 굉장히 낮아지는 효과

Data representation

데이터를 어떻게 잘 표현할 것인가

mnist 데이터 는 벡터 행렬로 등등

텍스트는? 토큰,

원핫 인코딩

토큰나이저

BPE

반응형

'개발자_SHINBAK > 인공지능 김신박' 카테고리의 다른 글

| 맥 ffmpeg 설치 (homebrew 이용) (0) | 2020.12.28 |

|---|---|

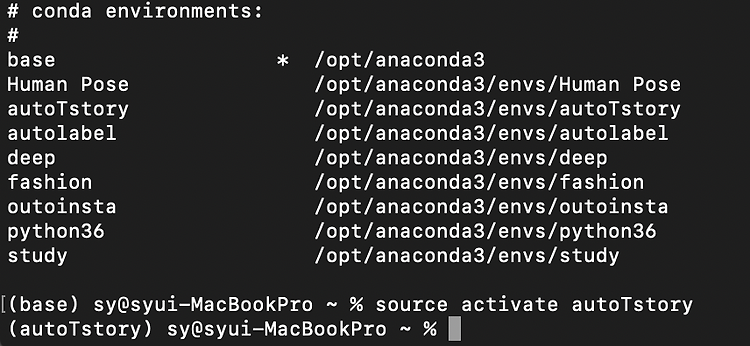

| 맥북 프로나 리눅스에서 아나콘다 환경실행 하기 (0) | 2020.12.28 |

| mac os conda activate 커맨드 오류 해결 방법 (0) | 2020.11.23 |

| NLP 이론 시험 요약 (0) | 2020.07.29 |

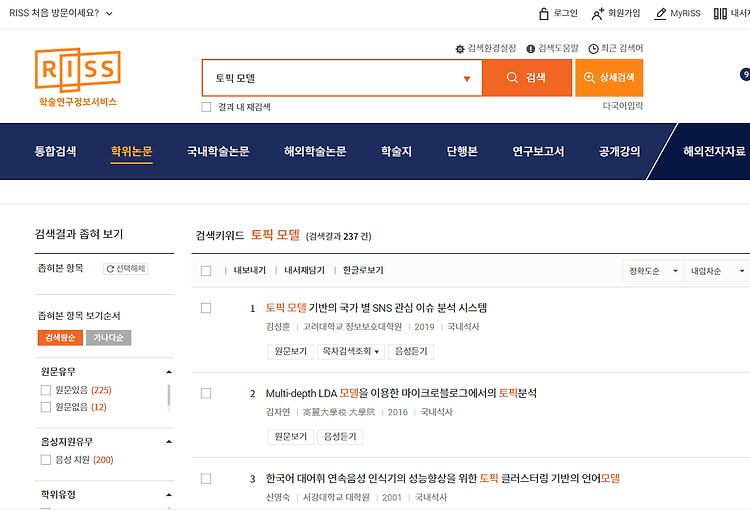

| 논문검색 사이트 RISS (0) | 2020.07.29 |

@kimshinbak :: 김신박

problem solver 개발자, 맛있는 음식이 행복한 남자

포스팅이 좋았다면 "좋아요❤️" 또는 "구독👍🏻" 해주세요!